Привет! Продолжаю линейку постов посвященную фильтрам Гугла и сегодня речь пойдет о фильтре Пингвин (Penguin), который борется с сайтами использующими черные методы продвижения (SEO), но в отличии от своих собратьев может быть применен к площадкам, как в ручном, так и в автоматическом режиме.

В предыдущем посте мы познакомились с фильтром Панда, узнали что это за такой зверь, кто его придумал и с какой целью он был выпущен на просторы всемирной сети.

Однако не успели вебмастера разобраться с Пандой (убрать спам на страницах, удалить дублирующий контент) одним словом сделать свои сайты безобидными в глазах посетителей и поисковиков, как на свет (апрель 2012 года) Google выпускает новый фильтр под кодовым словом Пингвин, который занижает в выдаче сайты с некачественным ссылочным профилем.

Зачем был создан Penguin

Давайте заглянем в прошлое и посмотрим, как раньше продвигались сайты. Например, нужно было выйти в ТОП по какому-нибудь высокочастотному запросу.

Что для этого делал вебмастер, писал оптимизированную статью, где неоднократно употреблял ключевое слово в содержании статьи, а затем, используя ссылочные биржи, покупались десятки ссылок, притом с доноров не самого лучшего качества, в которых анкор и был продвигаемый запрос.

В итоге такой псевдо СДЛ сайт занимал высокие места в ТОП Гугл и получал тонны трафика. Конечно же, это не могло продолжаться долго и Google был вынужден настроить свои алгоритмы таким образом, чтобы исключить из выдачи некачественные сайты, умышленно завышающие свои позиции.

Если с контентом начала бороться Панда, то следить за качеством входящих и исходящих ссылок пришлось новоиспеченному Пингвину, который после запуска изменил всемирную выдачу до неузнаваемости.

Penguin — это кодовое слово очередного фильтра от Гугла, который фильтрует сайты, опуская из на низкие позиции в выдаче, за неестественную ссылочную массу.

Ниже мы более детально рассмотрим те факторы, за которые применяются санкции к площадкам.

За что наказывает фильтр Пингвин

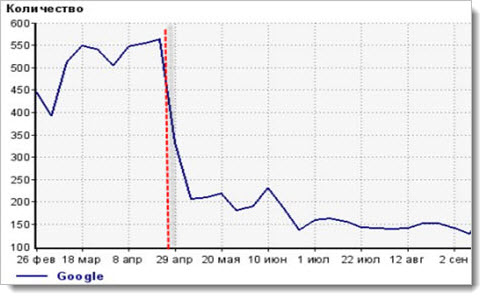

Если после очередного обновления данного фильтра вы заметили, что трафик резко пошел вниз, то скорее всего к сайту были применены санкции.

Посмотрите на один сайт, который пострадал от Пингвина в день его выхода на свет.

Причины, из-за которых страдают сайты:

Качество входящих ссылок. Теперь для Гугла неважно количество входящих ссылок, ему важно качество, а самое главное естественность. Все остальное может быть расценено, как умышленное манипулирование результатами выдачи, к которым следует отнести:

— Ссылки, у которых в анкоре присутствует прямое вхождение ключевых слов;

— Размещение ссылок на заспамленных, некачественных площадках;

— Обмен ссылками;

— Сквозные ссылки в футере и сайдбаре;

— Неравномерное распределение ссылок по страницам сайта.

Исходящие ссылки. Если вы решили поставить исходящую ссылку, то обязательно проверьте сайт, на который хотите ссылаться, потому что он должен быть качественным, а не спамным.

То же самое касается вебмастеров зарабатывающих на продаже ссылок. Если на сайте в основном присутствуют коммерческие или нетематические ссылки, то велика вероятность, что такая площадка может попасть под клюв Пингвина.

Скорость прироста ссылок. Ссылки должны появляться на сайт постепенно, по мере его развития. Если вы любите в качестве средств продвижения использовать прогоны по базам профилей и каталогов, то пора с этим завязывать.

Гуглу не понравится, если вчера на ваш сайт вело 100 линков, а спустя день уже ссылается 1000 — это явный признак линкспамерства.

Все вышеперечисленное можно заменить одним словом — ЕСТЕСТВЕННОСТЬ.

Как проверить под каким фильтром находится сайт

Если в один прекрасный день вы по неизвестным причинам лишились трафика из поисковой сети Google, то первым делом надо определить под каким именно фильтром находится ваша площадка, чтобы разработать стратегию по скорейшему снятию санкций.

Как я уже писал, фильтр Пингвин имеет две разновидности в плане применения к площадкам: ручной и автоматический.

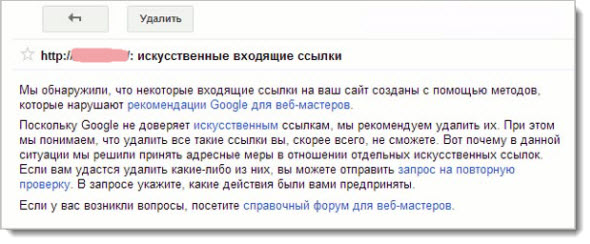

При ручном методе наложения санкций, как правило, приходит уведомление в панели Гугл Вебмастер, в котором сообщается, из-за чего пострадал сайт.

Содержание письма может в некоторых случаях отличаться, но суть его остается одна и та же — избавиться от некачественных и неестественных бэклинков. После чего надо отправить запрос на перепроверку площадки.

Чтобы найти это уведомление нужно инструментах для вебмастеров перейти в раздел «Поисковый трафик» далее «Меры, принятые вручную».

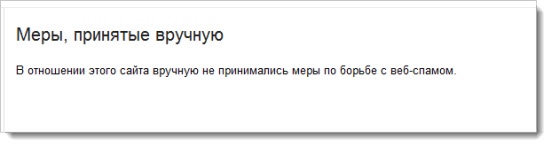

Если сайт подвергся ручным санкциям, то в этом разделе будет находиться злосчастное письмо от службы по борьбе с поисковым спамом. Но большинство вебмастеров видит следующую картину.

В этом случае ручной фильтр Пингвина к проверяемой площадке не был применен и следует копать в сторону автоматического.

Пингвин, как и другие фильтры, периодически обновляет свою базу некачественных площадок, а статистика показывает, что это происходит два раз в год.

Ниже я выписал последние даты, когда произошел апдейт Penguin:

24 апреля 2012 года

25 мая 2012 года

5 октября 2012 года

22 мая 2013 года

4 октября 2013 года

17 октября 2014 года

Теперь нужно сопоставить день, когда начался спад трафика с днем обновления фильтра и если эти числа совпадают, считайте истинная причина пессимизации площадки в выдаче установлена и можно приступать к ее лечению.

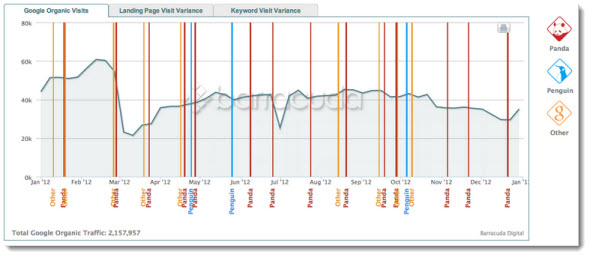

Но есть и другой способ узнать, под какой именно фильтр от Гугла попал сайт. Решением стал зарубежный сервис под названием Barracuda.

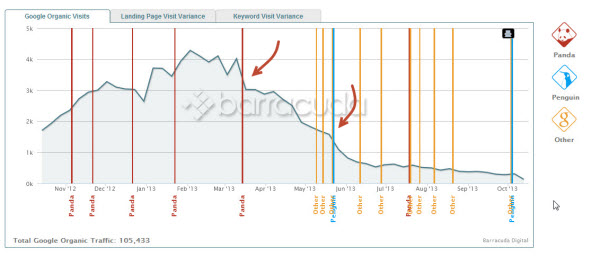

В его арсенале есть продукт Panguin Tool, который берет данный из статистики Google Analytics, а затем накладывает на график посещаемости даты обновления всех фильтров, что позволит лучше оценить, какой из них повлиял на ранжирование страниц сайта.

Для того чтобы его опробовать в действии на вашем сайте должна быть подключена статистика Гугл Аналитикс, правда для того чтобы воспользоваться услугами этого сервиса придется предоставить ему данные для входа в Аналитику, что не всегда может быть безопасным, однако я по этому поводу заморачиваться не стал.

1) Входим в свой аккаунт Гугл Аналитики, для чего нажимаем на кнопку «Log-in to Analytics».

2) Далее вам надо подтвердить право на предоставление доступа приложения «Barracuda Digital».

3) Теперь надо выбрать тот аккаунт сайта, с которого будет сниматься статистика посещаемости.

4) Перед вами появится заветный график за последний год, на который будут нанесены все даты обновления Гугл фильтров.

Если посмотреть на статистику моего блога, вывод напрашивается неоднозначный. Четко видно, что падение трафика началось с обновления Панды, а когда трафик начал уменьшаться, произошел апдейт Пингвина, что тоже могло повлиять на ранжировании сайта в целом.

Теперь передо мной стал вопрос, под каким именно фильтром находится мой блог: Пандой или Пингвином? Буду рад, если в комментариях вы поможете мне в этом разобраться.

Как вернуть позиции сайта и победить Пингвина

Если с Пандой дела обстоят неоднозначно и чтобы ее победить, надо смотреть в сторону контента, то с Пингвином все куда радужней, так как достаточно убрать некачественные и неестественные ссылки на сайте и в случае с ручным фильтром отправить сайт на перепроверку, а с автоматическим ждать, когда случится апдейт.

Но как убрать такие ссылки, а также как узнать какие из них качественные, а какие нет? Если с исходящими ссылками все понятно, достаточно пробежаться по статьям и поставить на них запреты noindex и nofollow, то с входящими вечными линками все намного сложнее.

Для таких ситуаций Гугл пошел навстречу вебмастерам и придумал сервис Disavow links по отклонению ссылочной массы, которая не будет учитываться алгоритмами поисковика при ранжировании сайта.

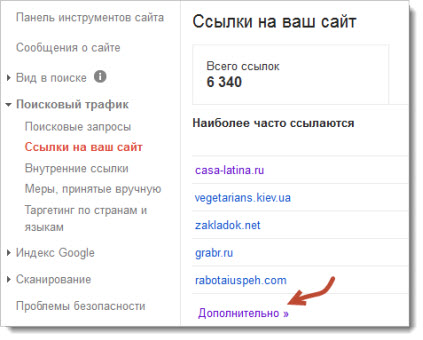

Все что нам нужно это скачать список всех ссылающихся сайтов, о которых известно Гуглу, далее проверить их на качество, а затем все некачественные площадки отправить в Disavow links, сообщая тем самым, что на них не нужно обращать внимание при анализе ссылочной массы.

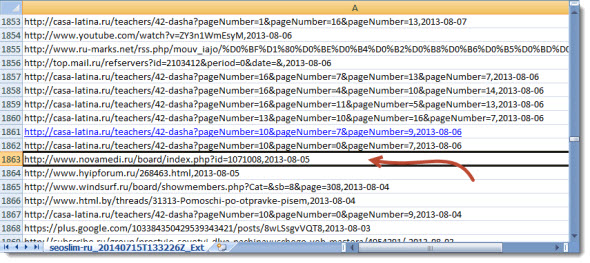

Скачиваем список входящих ссылок. Для этого идем в панель инструментов Гугл Вебмастер в раздел «Поисковый трафик» далее «Ссылки на ваш сайт» и в самом низу списка жмем «Дополнительно».

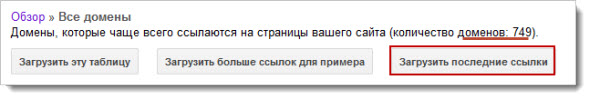

Далее надо выгрузить все ссылки к себе на компьютер. Для этого нажимаем кнопку «Загрузить последние ссылки», еще обратите внимание, что ссылок у вас будет куда больше, чем входящих доменов.

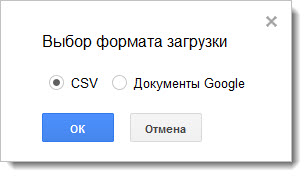

Затем выбираете, в каком формате надо сохранить список ссылок, я придерживаюсь документа Excel.

Далее у вас два варианта, как проверить полученный список ссылок на качество:

— Самостоятельно просматривать все доноры из списка, проверять их показатели, опираясь на свои навыки.

— Доверить проверку специальным сервисам, о которых я рассказал в статье «Как проверить ссылки на предмет качества».

Я пошел по более простому для меня варианту, так как не считаю, что могу потратить столько времени, чтобы проверить около 1000 доменов.

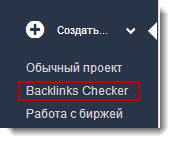

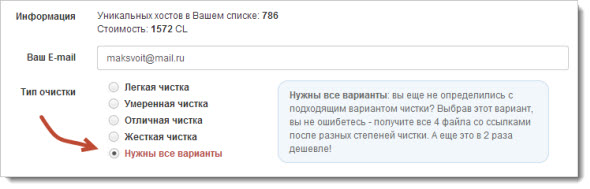

Переходим в сервис CheckTrust и выбираем в меню создать проект «BackLinks Checker».

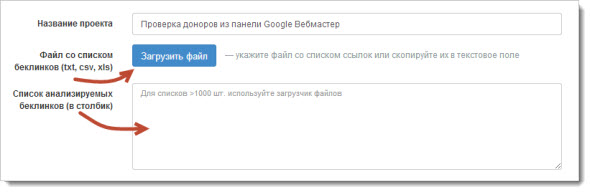

Далее вводим любое название проекту и загружаем скаченный ранее файл со ссылками. Если какие-то ссылки из файла вы уже проверили сами, то можете вставить список оставшихся ссылок в специальное поле для проверки и нажимаем «Далее».

Далее вам надо выбрать тип очистки:

Легкая чистка — удалению подвергнутся только бэклинки с самых некачественных сайтов.

Умеренная чистка — в список попадут все подозрительные сайты по качеству оцениваемые как ниже среднего.

Отличная чистка — все, вызывающее хоть какое-то подозрение, будет удалено.

Жесткая чистка — среди «выживших» останутся ссылки с сайтов только высшего качества, по статистике это не более 5-10% всех бэклинков.

Нужны все варианты — получите все 4 файла со ссылками после разных степеней чистки.

Сразу скажу, что берите лучше последний вариант, чтобы у вас были все списки, и вы наглядно видели какие из доменов все-таки стоит оставить.

После того как система проверит проект и его статус обработки станет «Выполнено» вам нужно будет по нему кликнуть, чтобы произошла его загрузка на компьютер.

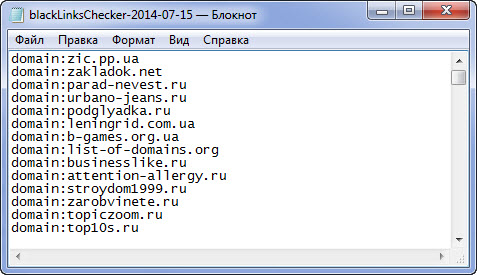

Это будет текстовый файл со списком сайтов, которые система посчитала некачественными и которые стоит добавить в сервис Disavow links от Google. Если посмотреть скаченный файл, то вы увидите примерно такую картину.

Именно в таком формате domain:сайт и надо отправлять все исключаемые площадки в Disavow links. Как видите, CheckTrust сделал неинтересную работу за вас.

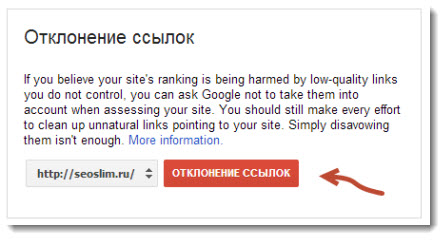

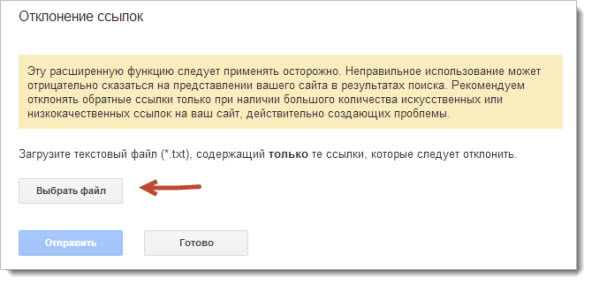

Теперь надо перейти в инструмент Disavow links, почему-то прямой ссылки на него из панели Гугл Вебмастер я не обнаружил, а далее выбрать сайт, для которого будете отклонять ссылки.

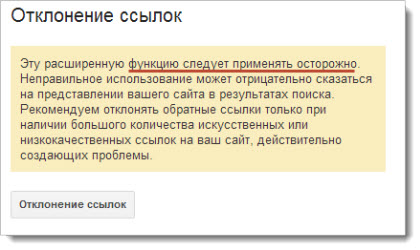

Читаем внимательно предупреждение, видно создано для тех, кто случайно решил воспользоваться этим инструментом.

Далее выбираем файл, который мы получили в сервисе проверки ссылок и нажимаем «Готово», а потом «Отправить».

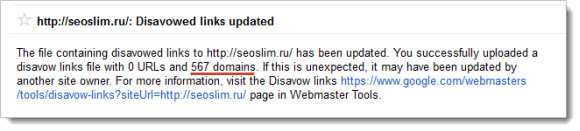

Если вы все сделали правильно, то в сообщениях о сайте должны получить уведомление, в котором будет стоять такая же цифра отклоненных доменов, сколько было в загружаемом файле.

После всех вышеописанных манипуляций останется ждать, когда произойдет обновление фильтра Пингвин и с сайта снимутся санкции, но при этом не стоит забывать, что ссылки должны постоянно прибавляться. Гугл любит динамику постоянного роста качественной ссылочной массы.

Так что обратные бэклинки нужно добывать всеми возможными способами постоянно, а вот как это сделать вы узнаете в следующих постах, главное не пропустите!

На сегодня у меня все, расскажите, как вы победили фильтр Пингвин и какими инструментами для этого пользуетесь. Пока!

(7 голос., в среднем: 4,14 из 5)

(7 голос., в среднем: 4,14 из 5)

Что то гугл очень животных любит. Наверное следующий его фильтр будет называться хорек.

Эти фильтры появились именно с приходом Ларри Пейджа...

Что есть такие фильтры это правильно, потому что развиваться блоги должны более менее естественно, а не так, чтобы купил ссылки на статью с хороших площадок и вышел в ТОП. Один несколько лет старается, а другой решил по-быстрому заработать на блоге, не, не получится.

А раньше все было так легко и многие пользовались этими пробелами в алгоритмах.

Максим, а давно Ваш блог стал dofollow?

С чего вы это взяли?

Всё очень просто Смотрите, я оставляю ссылку ya.ru — для проверки. Проверим, открыта ли она для индексации.

Смотрите, я оставляю ссылку ya.ru — для проверки. Проверим, открыта ли она для индексации.

Если нет, то укажу, открытые ссылки из комментариев. Это Вам для размышления, почему Ваш блог под фильтром Google.

Ссылка оказалась открытой, а это значит, что все ссылки из комментариев открыты. Вот Вам и фильтр от Google (видимо решили, что ссылки Вы продаёте)

Теперь понял Все ссылки от индексации у меня раньше закрывал плагин WP-NoExternalLinks, но пару недель назад я от него избавился, после этого начал делать чистку всех ссылок, которые автоматически стали открытыми.

Все ссылки от индексации у меня раньше закрывал плагин WP-NoExternalLinks, но пару недель назад я от него избавился, после этого начал делать чистку всех ссылок, которые автоматически стали открытыми.

Возможно в коком-то посте есть ссылка, но это все временно.

Вроде, блог не под фильтром, но почему-то трафика из гугла нет совсем (всего пару раз было). вроде, не под фильтром, но тогда почему. Правда, блог молодой (7 мес), да и запросы затачиваю под яндекс.

Скорее всего Надежда, ваш блог под фильтром «Песочница», все новички под него попадают.

Все только и говорят о том, что Пингвин понизил сайт в выдаче и так далее... Хотелось бы услышать на сколько выдача изменилась в лучшую сторону, на сколько выдача очистилась от ГС, кто не будь видел подобный материал? 🙂

Приветствую всех. У меня вопрос, а как вы выделяете некоторые предложения в рамку. Например, как в статье:

Penguin — это кодовое слово очередного фильтра от Гугла, который фильтрует сайты, опуская из на низкие позиции в выдаче, за неестественную ссылочную массу.

А у меня пол года назад была такая ситуация с Яшой, трафик резко и внезапно упал, до сих пор ищу причину, а вот Гугл мне дает стабильно его.

Именно из-за таких фильтров как пингвин,я боюсь связываться с ссылками. как с их покупкой,так и с продажей

Кстати, ссылки могут быть и в шаблоне ворд пресс, у меня были зашифрованы в двоеточие ) Когда проверила — ужас, под тысячу... Даже и продавть их не обязательно, чтобы схватить фильтр от гугл... Отдельное спасибо за пост! Долго не могла найти инфу по фильтрам, думала их нельзя проверить, бан и бан... а здесь все по полочкам о наболевшем )))

У вас Оксана на блоге в футере на каждой странице стоит исходящая ссылка.

Ссылки в футере стоят в основном на бесплатных шаблонах, своего рода плата за бесплатность. В принципе кто сам не может убрать, может обратиться к фрилансеру, чтобы тот убрал ссылку из футера.

Спасибо, Максим! Буду ее убирать, я недавно поменяла шаблон и еще не успела!

А у меня такой вопрос, у меня несколько сайтов, но почему то для анализа доступен один. Где кнопочки для добавления еще сайтов? Вообще конечно же очень нужный сервис, но заморочистый жутко... Если уж они стремятся к минимализму, то все должно быть интуитивно понятно и просто, у яндекса намного панель веб мастера удобней

Вы про какой сервис говорите Оксана?

А у меня сайт под фильтр попал 16 ноября 14 года, интересно, обновления какого фильтра было в этот промежуток времени

Я раньше не знал как закрывать исходящие ссылки от индексирования, потом научился через nofollow, затем многие начали говорить что nofollow уже не работает, а нужно закрывать через тег span. Вообщем всегда нужно следить за нововведениями поисковиков, и стараться вести блог или сайт качественно.

Жаль что эти фильтры обновляются всего раз в полгода. Вот так попадешь случайно под фильтр, а отдуваться придется полгода минимум.

Спасибо Вам за полезную информацию![[good] [good]](https://seoslim.ru/wp-content/plugins/qipsmiles/smiles/6.png)

![[good] [good]](https://seoslim.ru/wp-content/plugins/qipsmiles/smiles/6.png)

![[good] [good]](https://seoslim.ru/wp-content/plugins/qipsmiles/smiles/6.png)

>Гуглу не понравится, если вчера на ваш сайт вело 100 линков, а спустя день уже ссылается 1000 — это явный признак линкспамерства.<

А если у меня сайт по конкретной тематике под названием "Азбука сайтов по теме "......", тогда как быть? Ведь на этом сайте может быть, утрировано говоря, и миллион ссылок.

Например сайт учебных заведений Мира естественно будут ссылки на сайты образовательных учреждений каждой страны и республики.

Второй пример, уникальный классификатор адресов, где ссылка о каждом наименование адресного объекта ведёт на страничку об этом месте. (под наименование адресного объекта, я подразумеваю: улицы, тупики, проезды, аллеи и т. п. )

В статье речь идет о входящих внешних ссылках.

Очень много людей страдают от этих фильтров, даже не зная этого. Я как то зашел на сервис, проводил аудит сайта и увидел что мой блог побывал под данным фильтром. Когда, как, почему, так и не понял( Но вроде пока все нормально.